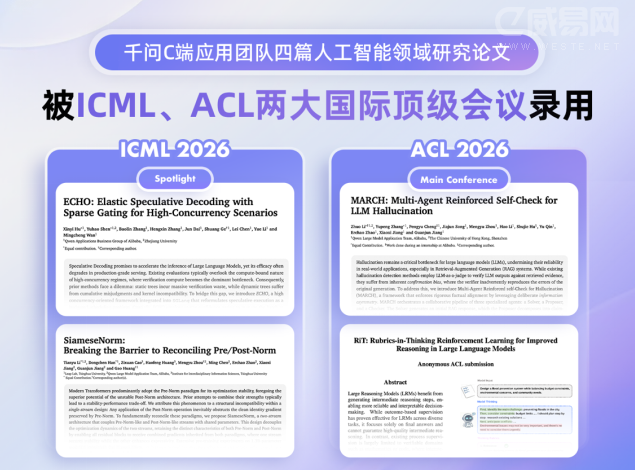

ICML(国际机器学习大会)与ACL(国际计算语言学年会)分别是机器学习与自然语言处理领域历史最悠久、影响力最大的顶级学术会议,每年录用的论文代表着相关方向的前沿突破。今年ICML投稿量翻倍,Spotlight入选比例仅2.2%;ACL主会论文接收率仅19%。

千问C端应用团队入选的四篇论文均从实际应用痛点出发,覆盖推理加速、幻觉治理、架构优化与结构化推理四个方向。

大模型高并发时的“卡顿”,本质是算力没花在刀刃上。入选ICML Spotlight的ECHO框架,独创“稀疏门控”与“弹性预算调度”机制,把投机解码变成一道“算力怎么花最划算”的调度题——系统不再盲目验证所有预测,而是精准瞄准模型深度的“甜蜜点”进行关键核验,并根据实时置信度动态向高确定性任务倾斜算力。在Qwen3-235B等工业级模型实测中,ECHO端到端吞吐比EAGLE-3等现有最优方法提升最高36%。

比“答得快”更难的,是“答得准”。入选ACL主会的MARCH框架,专攻大模型的“幻觉”难题。传统核查容易“顺着错误自圆其说”,MARCH引入“刻意的信息不对称”机制,构建解答者、提案者与审查员的三位一体流水线,强制审查员在“信息隔离舱”内依据客观文档独立“盲审”。该机制驱使大模型必须在每个校验环节拿出真凭实据,彻底切断了自我幻觉确认的偏误循环。同时配合多智能体强化学习的交叉惩罚机制,让模型能力在多Agent交互过程中自我进化。在金融研报、合同审查等场景中,MARCH为大模型自动筑起事实防线,确保每条结论都链接到底层数据支撑,有效帮助用户阻断微小幻觉引发的“错误雪崩”。

模型想“稳”就容易“笨”,想“灵”又容易“飘”。入选ICML的SiameseNorm架构,直击大模型“稳定性与表达力难以兼得”的痛点。它采用参数共享的双流设计,一条流负责稳住梯度回传,另一条流负责释放表达潜能,在不增加参数负担的前提下,让模型获得更强的复杂逻辑推导能力。

而面对没有标准答案的复杂任务,大模型又容易“想得多却想不精”。入选ACL Findings的RiT框架,给模型的“内心思考”装上了质量把控器。通过细粒度评价准则(Rubric)和门控融合奖励机制,引导AI在处理深度行业分析、营销推演等任务时,严格遵循专业思维框架步步推演,而不是在黑盒里随意发散,确保最终交付成果具备极高的逻辑密度与专业可信度。

这四项成果覆盖了用户体验上的“最后一公里”,也触及了制约模型能力上限的底层机制。随着四篇论文代码的陆续开源,相关技术将为行业提升AI可靠性、实用性提供参考。