¥ΪΆ≥ΒΡ RAGΘ®ΦλΥς‘ω«Ω…ζ≥…Θ©œΒΆ≥ΦΗΚθάκ≤ΜΩΣ»ΐΦΰΧΉΘΚœρΝΩ«Ε»κΓΔΈΡΒΒ«–ΩιΓΔœρΝΩ ΐΨίΩβΓΘΒΪ≈ωΒΫ≥ΛΉ®“ΒΈΡΒΒ——≤Τ±®ΓΔSEC ΈΡΦΰΓΔ―–ΨΩ¬έΈΡΓΔΖ®¬… ÷≤α——’βΧΉΖΫΑΗΜᱩ¬ΕΈ ΧβΓΘœύΥΤΕ»ΗΏ≤Μ¥ζ±μœύΙΊ–‘«ΩΘ§«–ΩιΜα«–Εœ…œœ¬ΈΡΘ§œρΝΩΦλΥς“≤»ί“ΉΕΣ ßΈΡΒΒΒΡΫαΙΙ–≈œΔΓΘΫαΙϊ «’ΌΜΊ≤ΜΉΦΓΔΫβ Ά–‘≤νΓΔΜΟΨθ‘ωΕύΓΘ

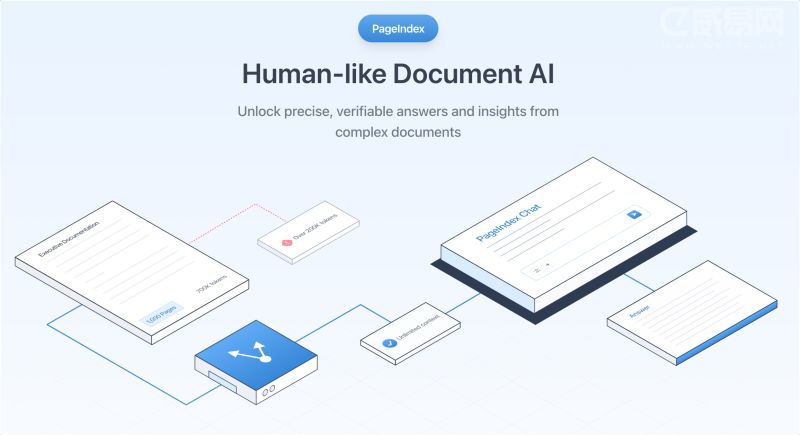

PageIndex ”… VectifyAI ΩΣΖΔΘ§ΉΏΝΥ“ΜΧθ≤ΜΆ§ΒΡ¬ΖΓΘΥϋ≤Μ”ΟœρΝΩ ΐΨίΩβΘ§“≤≤ΜΉω»Έ“β«–ΩιΘ§Εχ «Α―ΈΡΒΒΫ®≥…≤ψ¥ΈΜ· ςΉ¥Υς“ΐΘ§»Ο LLM ‘Ύ ς…œΆΤάμΒΦΚΫΘ§’“ΒΫΉνœύΙΊΒΡΕΈ¬δΓΘ

PageIndex «‘θΟ¥ΙΛΉςΒΡ

ΥΦ¬Ζά¥Ή‘ AlphaGo ΒΡ ςΥ―ΥςΘ§Ζ÷ΝΫ≤ΫΘΚ

ΒΎ“Μ≤ΫΘΚ…ζ≥… ςΉ¥Υς“ΐ

Α― PDF Μρ Markdown ΈΡΒΒΉΣ≥…άύΥΤΡΩ¬ΦΒΡ≤ψ¥Έ ςΫαΙΙΓΘΟΩΗωΫΎΒψ¥χΉ≈±ξΧβΓΔ’Σ“ΣΓΔ“≥¬κΖΕΈßΚΆ≤ψΦΕΙΊœΒΓΘΈΡΒΒΒΡ‘≠ ΦΫαΙΙΆξ’ϊ±ΘΝτΘ§≤ΜΜα±Μ«–≥…ΥιΤ§ΓΘ

ΒΎΕΰ≤ΫΘΚΆΤάμΥ―Υς

”ΟΜßΧαΈ ΚσΘ§LLM ΉςΈΣ¥ζάμ‘Ύ ς…œΆΤάμ——≈–ΕœΡΡ–©Ζ÷÷ßœύΙΊΓΔ“Σ≤Μ“Σ…ν»κΉ”ΫΎΒψΓΔ»γΚΈΉιΚœ–≈œΔΓΘ’ϊΗωΙΐ≥ΧΩ…ΉΖΥίΘ§ΡήΩ¥ΒΫΡΘ–ΆΉΏΙΐΝΥΡΡ–©¬ΖΨΕΓΔ“ΐ”ΟΝΥΡΡ–©’¬ΫΎΚΆ“≥¬κΓΘ

’β”–Βψœώ»ΥΕΝΚώ ιΒΡΑλΖ®ΘΚœ»Ζ≠ΡΩ¬ΦΚΆ¥σΗΌΘ§‘Ό”–’κΕ‘–‘ΒΊ≤ιΨΏΧε’¬ΫΎΓΘ

ΚΆœρΝΩ RAG ΒΡΕ‘±»

| Έ§Ε» | œρΝΩ RAG | PageIndex |

|---|---|---|

| ΦλΥςΖΫ Ϋ | œρΝΩœύΥΤΕ»ΤΞ≈δ | LLM ‘Ύ ςΉ¥Υς“ΐ…œΆΤάμΒΦΚΫ |

| ΈΡΒΒ¥Πάμ | –η“Σ«–ΩιΘ®chunkingΘ© | ±ΘΝτΉ‘»Μ’¬ΫΎΫαΙΙ |

| ¥φ¥Δ“άάΒ | –η“ΣœρΝΩ ΐΨίΩβ | Έό–ηœρΝΩ ΐΨίΩβ |

| Ω…Ϋβ Ά–‘ | ΚΎœδΘ§Ρ―ΉΖΥί | ΦλΥς¬ΖΨΕΆΗΟςΘ§ΨΪ»ΖΒΫ“≥¬κΚΆ’¬ΫΎ |

| ―”≥Ό | ΒΆΘ®ΚΝΟκΦΕΘ© | ΫœΗΏΘ®ΟκΦΕΘ§–ηΕύ¥Έ LLM Βς”ΟΘ© |

| …Ο≥Λ≥ΓΨΑ | ΕΧΈΡ±ΨΓΔΆ®”Ο÷Σ ΕΦλΥς | ≥ΛΫαΙΙΜ·ΈΡΒΒΓΔΉ®“ΒΝλ”ρ QA |

Μυ”Ύ PageIndex ΙΙΫ®ΒΡ Mafin 2.5 ‘Ύ FinanceBench …œ¥οΒΫΝΥ 98.7% ΒΡΉΦ»Ζ¬ ΓΘΆ§“ΜάύΫπ»Ύ QA »ΈΈώ…œΘ§¥ΪΆ≥œρΝΩ RAG Ά®≥Θ‘Ύ 30% ΒΫ 60% ÷°ΦδΓΘ

ΒΦ Ι”Ο÷–ΒΡ”≈»±Βψ

ΉωΒΟΚΟΒΡΒΊΖΫΘΚ

- ΈΡΒΒΫαΙΙ±ΘΝτΆξ’ϊΘ§ ΚœΫπ»ΎΓΔΖ®¬…Β»Ή®“ΒΝλ”ρΒΡΈ ¥π

- ΦλΥς¬ΖΨΕ»ΥάύΩ…άμΫβΘ§…σΦΤΚΆΚœΙφΖΫΟφ±»Ϋœ”―ΚΟ

- MIT ΩΣ‘¥–≠“ιΘ§÷ß≥÷±ΨΒΊ LLMΘ§Ά®Ιΐ LiteLLM Φφ»ίΕύ÷÷ΡΘ–Ά

- ΧαΙ© Cookbook ΚΆ Notebook ΨάΐΘ§…œ ÷≤ΜΡ―

–η“ΣΉΔ“βΒΡΒΊΖΫΘΚ

- Υς“ΐΙΙΫ®ΚΆΦλΥς ± LLM Βς”Ο¥Έ ΐΕύΘ§token œϊΚΡΚΆ―”≥ΌΕΦΗΏ”Ύ¥ΩœρΝΩΦλΥςΓΘΒΞ¥Έ≤ι―·Ω…Ρή“ΣΦΗΟκΘ§Ηϋ ΚœΨΪΕ»”≈œ»ΒΡ≥ΓΨΑ

- Ε‘ΫαΙΙ«εΈζΒΡΈΡΒΒ–ßΙϊΉνΚΟΘ§ΡΎ»ίΦΪΕ»‘”¬“ΒΡΜΑΩ…Ρή–η“ΣΕνΆβ¥Πάμ

- Υς“ΐ «“Μ¥Έ–‘ΙΙΫ®ΒΡΘ§Κσ–χ≤ι―·Ω…“‘Η¥”Ο

ΩλΥΌ…œ ÷

1. ΩΥ¬Γ≤÷ΩβΘΚgit clone https://github.com/VectifyAI/PageIndex

2. Α≤ΉΑ“άάΒ≤Δ…η÷Ο LLM API KeyΘ®÷ß≥÷ OpenAI Β»Εύ÷÷ΡΘ–ΆΘ©ΓΘ

3. …ζ≥… ςΥς“ΐΘΚpython3 run_pageindex.py --pdf_path your_document.pdf

4. ”Ο Cookbook Μρ Agentic Ψάΐ¥νΫ® RAG ”Π”ΟΘ®Αϋά®”κ OpenAI Agents SDK ΫαΚœΒΡΖΫΑΗΘ©ΓΘ

≤÷ΩβΜΙ÷ß≥÷ Markdown ÷±Ϋ”¥ΠάμΚΆ Vision-based ΙήΒάΘ®¥Ω ”Ψθ“≥ΟφΆΦœώΘ§≤Μ–η“Σ OCRΘ©ΓΘ

VectifyAI ΜΙΧαΙ©ΝΥ‘ΤΕΥ Chat ΤΫΧ®Θ®chat.pageindex.aiΘ©ΓΔMCP ΚΆ API ΖΰΈώΘ§ Κœ…ζ≤ζ≤Ω πΓΘΤσ“Β”ΟΜß”–ΥΫ”–Μ·ΖΫΑΗΩ…―ΓΓΘ

Έ“ΒΡΩ¥Ζ®

PageIndex ΒΡΚΥ–Ρ÷ς’≈ΚήΦρΒΞΘΚΕ‘–η“ΣΕύ≤ΫΆΤάμΒΡΉ®“ΒΈΡΒΒΘ§»Ο LLM "ΥΦΩΦ"±»»ΟΥϋ"ΤΞ≈δ"Ηϋ”––ßΓΘ’βΗωΖΫœρ”–ΥΒΖΰΝΠΘ§”»Τδ «‘Ύ FinanceBench …œΡΟΒΫΒΡ≥…Φ®ΓΘ¥ζΦέ « token ≥…±ΨΚΆ―”≥Ό——»γΙϊΡψ–η“ΣΚΝΟκΦΕœλ”ΠΘ§œρΝΩΦλΥς»‘»ΜΗϋΚœ ΓΘΒΪ»γΙϊΡψ‘ΎΉω≤Τ±®Ζ÷ΈωΓΔΖ®Ιφ≤ι―·ΓΔ¬έΈΡΦλΥς’βάύΨΪΕ»”≈œ»ΒΡ»ΈΈώΘ§PageIndex ÷ΒΒΟ ‘“Μœ¬ΓΘ

≤ΈΩΦΝ¥Ϋ”

- GitHub ≤÷ΩβΘΚgithub.com/VectifyAI/PageIndex

- ΈΡΒΒ”κ CookbookΘΚdocs.pageindex.ai

- Chat ―ί ΨΤΫΧ®ΘΚchat.pageindex.ai