4月27日,小米 MiMo 官方宣布:MiMo-V2.5 系列模型全部正式开源!

采用极其宽松的 MIT 协议,支持商用部署、继续训练和微调,无需额外授权。这对 AI Builder、独立开发者以及 Agent 框架团队来说,是一个超级利好消息。

MiMo-V2.5 系列包含哪些模型?

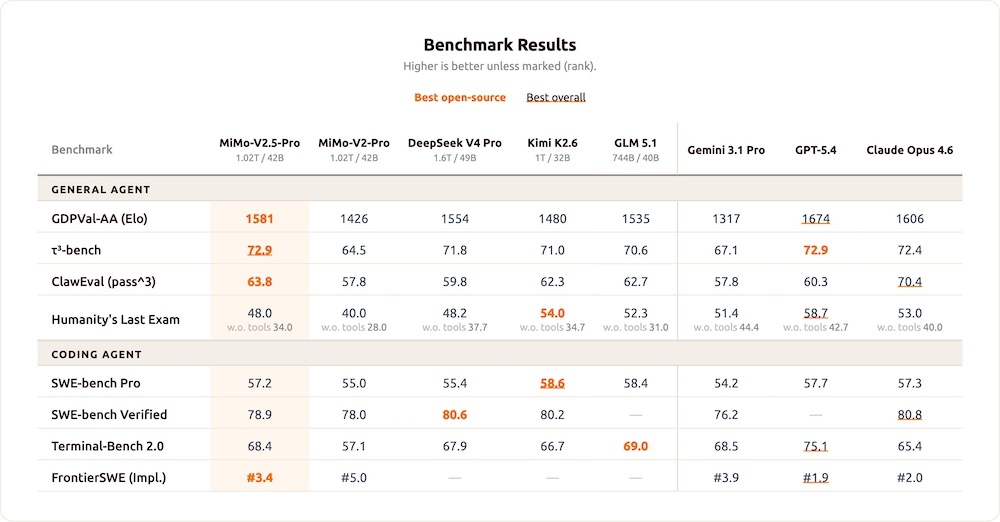

- MiMo-V2.5-Pro:专为复杂 Agent 和 Coding 任务设计,在开源模型中登顶 GDPVal-AA 和 ClawEval 榜单,擅长长上下文、多步推理和工具调用。

- MiMo-V2.5:原生多模态(Omni-modal)模型,具备强大的 Agent 能力,支持文本、图像、视频、音频等多种模态。

两款模型均支持 1M(百万)Token 超长上下文窗口,在长文档理解、复杂 Agent 工作流中表现突出。

核心亮点

- MIT 协议 —— 完全开源、可商用、可二次开发、可继续预训练,无任何额外限制。

- 1M Token 上下文 —— 真正能处理超长输入,适合代码仓库级、文档级、长链条 Agent 任务。

- 强悍的 Agent 与 Coding 能力 —— MiMo-V2.5-Pro 在多个 Agent 评测中位居开源模型第一。

- Day-0 生态支持 —— 发布当天即支持 SGLang 和 vLLM 推理框架,同时在 AWS、AMD 以及多家国内加速芯片(天核、昆仑芯、恩科、摩尔线程等)上实现 Day-0 适配。

重磅福利:MiMo Orbit 100T Token 计划

小米同步推出 MiMo Orbit 百万亿 Token 计划,包含两大子计划:

- 百万亿 Token 创造者激励计划(面向 AI Builder)

申请通过的用户最高可获得 Max 档位 Token Plan,包含 16亿 Credits(价值约 659 元),完全免费。 - Agent 生态共建计划(面向 Agent 框架团队)

为 Agent 框架提供 MiMo Token 限免支持,让框架的用户可以免费体验 MiMo-V2.5 系列模型。

这波操作直接给开发者“发弹药”,大幅降低了试用和开发成本。

模型下载地址

- Hugging Face 主仓库:https://huggingface.co/XiaomiMiMo

- MiMo-V2.5 系列模型均已上线(含 Base 和 Pro 版本)

为什么值得关注?

MiMo-V2.5 的开源,不仅带来了高性能的长上下文 + Agent 模型,更重要的是以 MIT 协议 + 大规模免费 Token 激励的形式,大幅降低了国内开发者使用顶级开源大模型的门槛。

对于正在做 Agent、Vibe Coding、垂直 SaaS、自动化工具的开发者来说,这可能是近期最值得关注的开源模型发布之一。

写在最后

小米这次开源的姿态非常开放:真开源、真 MIT、真给 Token、真支持生态。这对整个开源 AI 社区是实打实的利好。

有做 Agent、长上下文应用、或本地部署需求的同学,强烈建议立刻去 Hugging Face 拉取模型试试,同时别忘了申请 Orbit Token 计划的免费额度。