2026年4月22日,在 Google Cloud Next 大会上,Google Cloud 正式发布了第八代 Tensor Processing Unit(TPU)。这次不是简单升级,而是直接拆成了两款专用芯片:TPU 8t 专门负责“训练”AI 模型,TPU 8i 则专门负责“推理”和未来的 AI 代理(agentic AI)。这就像把一辆多功能车,改造成一辆专攻赛道的赛车和一辆专跑日常的智能轿车,各司其职,效率爆表!

简单来说,AI 芯片就是让人工智能“大脑”跑得更快、更省电、更便宜的硬件。Google 的 TPU 就是他们自家研发的“AI 发动机”,这次新品直接瞄准了 AI 从“聊天工具”向“智能代理”转变的未来时代。

为什么这次发布这么重要?用大白话解释

想象一下,你要开发一个超级聪明的 AI:

- 训练阶段:就像给 AI 上学,让它看海量资料、学知识。这需要超级强的计算力和巨大内存,时间越短越好(以前可能要几个月,现在能缩短到几周)。

- 推理阶段(也就是日常使用):AI 要快速回答你的问题、规划任务、一步步执行(比如帮你订机票、分析报告)。这时候最重要的是“响应快、不卡顿、成本低”。

以前的芯片往往“一把抓”,训练和推理都用同一套,效率不高。现在 AI 越来越复杂,尤其是“AI 代理”——那种能自主思考、规划、多步操作的智能助手——对速度和能耗要求极高。Google 把芯片分开设计,就是为了让每个环节都跑到最优状态。

这次发布的重要性在于:

- 加速 AI 发展:训练更快,企业能更快做出强大模型;推理更高效,用户用起来更顺畅。

- 降低成本和能耗:Google 宣称性能/美元提升高达 80%,每瓦性能提升约 2 倍。这意味着企业花同样钱,能跑更多 AI 服务,还更环保(AI 数据中心耗电巨大,这点超级关键)。

- 挑战 Nvidia 主导地位:Nvidia 的 GPU 一直是 AI 芯片王者,Google 用自研 TPU 提供更具性价比的替代方案,帮助客户减少对单一供应商的依赖。

- 推动“代理式 AI”时代:未来 AI 不只是回答问题,而是像助手一样主动帮你做事。新芯片正是为此量身定制的。

一句话总结:这不只是硬件升级,而是 AI 从“实验阶段”真正走向大规模商业落地的重要一步。谁掌握了高效的 AI 基础设施,谁就掌握了未来竞争力。

TPU 8t:训练 AI 模型的“超级大力士”

- 专长:处理海量数据训练复杂模型。

- 亮点:单个超级集群(superpod)能扩展到 9600 颗芯片,共享高达 2PB 高带宽内存(这内存量大到能存下整个美国国会图书馆资料的 100 倍还多!)。芯片间连接带宽翻倍,整体训练性能比上一代提升近 3 倍。

- 好处:前沿大模型的开发周期从几个月缩短到几周,大大降低时间和金钱成本。

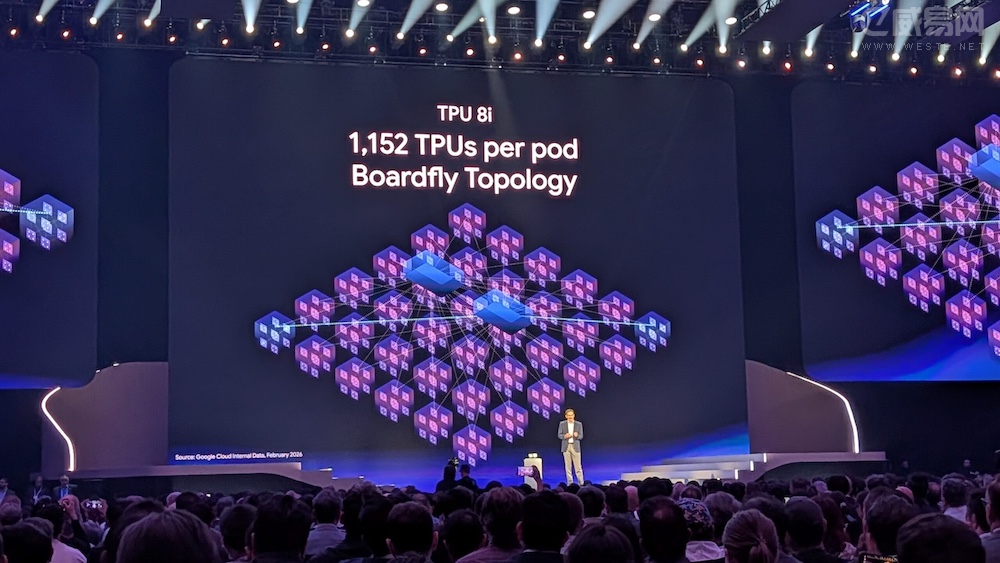

TPU 8i:推理和 AI 代理的“低延迟高手”

- 专长:让 AI 快速“思考”和响应,尤其适合多轮对话、复杂任务规划。

- 亮点:内存更大(288 GB 高带宽内存 + 片上 SRAM 大幅提升),能把常用数据全留在芯片里,避免来回“取数据”导致的延迟。专为实时多步推理优化,用户体验会更流畅。

- 好处:性能/美元比提升 80%,企业能以更低成本服务更多用户,同时大幅省电。AI 代理需要“快思考”,TPU 8i 就是为此而生。

对普通企业和开发者意味着什么?

- 成本更低:AI 开发和运行不再那么“烧钱”,中小企业也能玩得起。

- 速度更快:从idea到产品上线的时间缩短,创新周期加速。

- 选择更多:Google Cloud 用户可以根据需求选 TPU 或 Nvidia GPU,灵活性大增。

- 未来趋势:AI 将深入到工作、生活各个场景——自动处理业务、个性化服务、智能决策等,都会因为这些芯片变得更现实。

当然,新芯片预计在 2026 年晚些时候正式向 Google Cloud 客户开放。目前已经可以申请了解更多信息,为上线做准备。

结语:AI 硬件竞赛进入白热化

Google 第八代 TPU 的发布,标志着 AI 基础设施从“通用时代”迈向“专用优化时代”。它不仅让训练和使用 AI 更高效,还在能耗、成本和规模上带来实质突破。在 Nvidia 等巨头主导的市场里,Google 用自研芯片持续发力,给整个行业带来了更多活力和竞争。

对普通人来说,这意味着我们很快就能用到更聪明、更便宜、响应更快的 AI 服务——从智能助手到企业自动化工具,都将迎来新飞跃。